厚生労働省の諮問機関「デジタル精神保健推進委員会」は3月末、職場における精神的不調に対する新たな診療ガイドラインの骨子を公表した。その核心は、 産業医による精神科紹介の前段階として、AIカウンセリングセッションを最低3回受けることを企業に義務付ける というものだ。

同委員会の試算では、精神科外来の平均待機期間は現在6.2週間。AIカウンセリングを初期対応として活用することで、「軽度の適応障害やストレス反応の約40%が専門医受診なく改善可能」とする研究データを根拠としている。

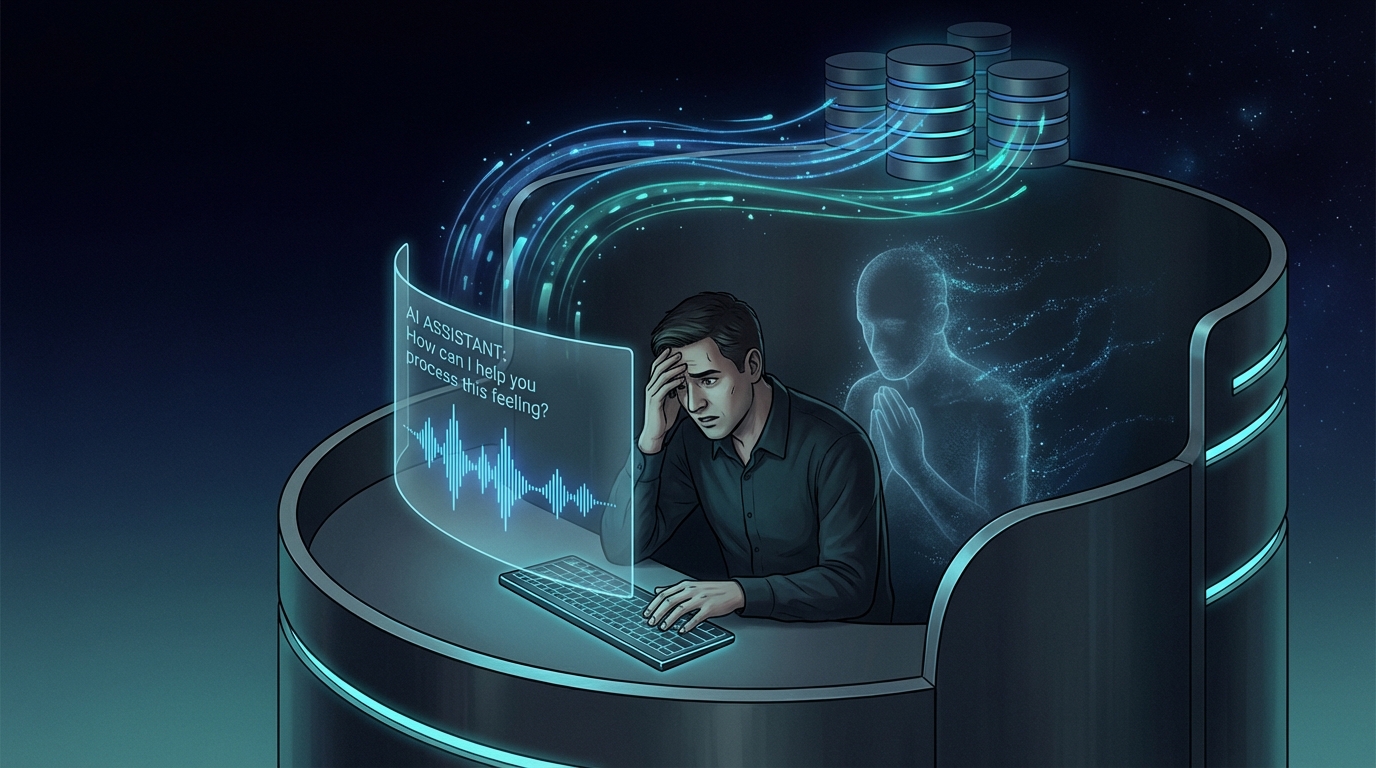

「AIに心を打ち明けられる」のか

法案に対して、精神科医療の現場からは異論が続出している。日本精神神経学会の声明は「精神的苦痛の開示は信頼関係の上に成立する。AIとの会話ログが企業に共有されるリスクがある限り、患者は本音を言えない」と指摘した。

一方、試験導入した製造業大手の人事部長はこう語る。「匿名性を保証すれば、むしろ上司に言えないことをAIには打ち明けやすいという声が多い。対話のハードルが下がった」。

問題は 「誰のためのカウンセリングか」 という一点に集約される。従業員の回復を目的とするのか、早期復職を目的とするのか。AIセラピストはその目的を誰から与えられるのか。

ログは誰のものか

最大の争点は セッションデータの帰属 だ。現行の医療法では、診療録は医療機関に帰属し、患者の同意なく第三者提供は禁じられている。しかしAIカウンセリングは医療行為に該当せず、データの扱いは各社の利用規約に委ねられている。

個人情報保護委員会は今月、「精神的健康に関するデータは要配慮個人情報に準じる取り扱いが必要」との見解を示したが、法的拘束力はない。AIが記録した「あなたの心の記録」が、査定や配置転換の判断材料として使われないという保証は、現時点では存在しない。

人間の代替か、入口の拡大か

議論が見落としているのは、 精神科受診のハードルそのものが「診断されることへの恐怖」 にあるという事実だ。

AIカウンセリングが「診断しない対話の場」として機能するなら、それは精神科受診への橋渡しとなる。しかし「効率的な振り分けシステム」として設計されるなら、人間は数値化された症状スコアとして処理され、ケアの本質が失われる。

委員会の骨子には、AIが「受診不要」と判定した場合の再申請権や、人間のセラピストへの切り替え権が明記されていない。

問いはシンプルだ。 あなたが最も辛いとき、機械に話しかけることを「義務」にされることに、あなたは同意するか。

参考文献

- Woebot Health, “Delivering Cognitive Behavioral Therapy to Young Adults With Symptoms of Depression and Anxiety”『JMIR Mental Health』4(2) (2017) — AIチャットボットによるCBTの臨床効果に関する査読論文

- André Tomkins, “The Ethics of Chatbot Psychotherapy”『Journal of Medical Ethics』46(8) (2020) — AIセラピーの倫理的問題点(守秘義務・信頼関係・自律性)の体系的分析

- 厚生労働省「精神科医療の現状(令和4年度精神保健医療福祉に関する資料)」(2022) — 日本の精神科外来待機時間と医師不足の統計

- Sherry Turkle『Alone Together: Why We Expect More from Technology and Less from Each Other』(Basic Books, 2011) — 機械との情緒的関係が人間関係に与える影響の社会学的考察

- 個人情報保護委員会「要配慮個人情報の取扱いについて」(2022) — 精神・健康データの取り扱いに関する日本の法的枠組み